近日,皇冠体育·(中国)官方网站几何计算与智能媒体技术团队以国家重大需求为目标导向,在多源图像融合领域取得2项最新科研成果,从自主无人系统在复杂恶劣场景中面临的实际问题出发,提出解决以多源图像融合为基础的一系列底层图像对齐和高层语义感知的难题的新方法。研究成果分别发表在计算机视觉顶级会议CVPR、人工智能领域顶级会议IJCAI、中科院推荐一区期刊Information Fusion上。

复杂恶劣场景中,单模态传感器遭受信息严重丢失的瓶颈的驱动下,多模态成像逐步成为自主驾驶领域的一项主要技术。最受关注的红外与可见光成像,不仅有利于提升恶劣场景下的成像质量,而且极大地促进了下游的视觉语义感知任务。团队的研究贯穿了多模态图像的成像矫正、多模态信息融合以及下游语义感知任务这一整条路径,分别针对成像过程中出现的多模态图像未对齐、多模态图像融合片面关注视觉质量而忽略语义传输、以及图像融合与多个下游语义感知任务不能适配联动等问题提出创新方法。

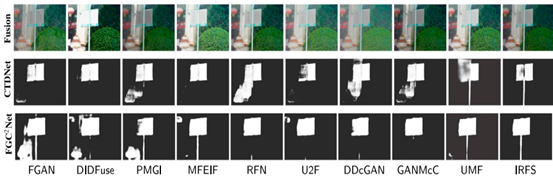

团队最新研究成果“An interactively reinforced paradigm for joint infrared-visible image fusion and saliency object detection”由软件学院博士研究生王迪、刘晋源,皇冠体育·(中国)官方网站刘日升教授、樊鑫教授共同完成,被中科院一区期刊Information Fusion录用。该项研究解决了无人系统在恶劣场景下目标定位不准的问题,不仅能够发现隐蔽目标而且能准确定位出复杂场景中最显著的目标。

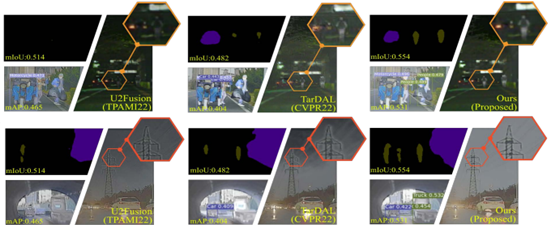

团队最新研究成果“Bi-level Dynamic Learning for Jointly Multi-modality Image Fusion and Beyond”由软件学院博士研究生刘铸,刘晋源博士,硕士研究生吴冠尧,马龙博士,皇冠体育·(中国)官方网站樊鑫教授、刘日升教授共同合作完成,被人工智能领域国际顶级学术会议IJCAI 2023接收。该项研究弥补了图像融合不能与多个下游语义感知任务适配联动的缺陷,不仅输出了视觉良好的融合图像,而且在检测和分割两个语义感知任务上较目前最先进的方法分别提升10.8%和15.2%。

团队在2022年的研究两项成果“Unsupervised Misaligned Infrared and Visible Image Fusion via Cross-Modality Image Generation and Registration”解决了未对齐多模态图像在融合过程中产生的结构扭曲、边缘重影问题,提升了图像融合的鲁棒性;“Target-aware Dual Adversarial Learning and a Multi-scenario Multi-Modality Benchmark to Fuse Infrared and Visible for Object Detection”解决了融合后图像目标不清晰、对下游感知任务不友好等问题,在多种挑战场景下,融合后的目标检测精度较最先进的方法提升10%以上。这一系列科研成果标志着科研团队在多源图像融合难题上的不断突破与创新。

据悉,IJCAI(International Joint Conference on Artificial Intelligence)是人工智能领域国际顶级学术会议之一,也是CCF推荐A类会议,本届IJCAI(2023)大会收到4566篇论文投稿,录用率仅为15%. Information Fusion是计算机科学领域的国际顶级期刊之一,致力于传播信息融合领域最新的研究和发展趋势,影响因子17.56,是中科院推荐一区期刊。

相关论文与代码链接如下:

[1]https://www.ijcai.org/proceedings/2022/0487.pdf

[2]https://github.com/wdhudiekou/UMF-CMGR

[3]https://arxiv.org/abs/2203.16220v1

[4]https://github.com/JinyuanLiu-CV/TarDAL

[5]https://www.sciencedirect.com/science/article/pii/S1566253523001446

[6]https://github.com/wdhudiekou/IRFS

[7]https://arxiv.org/pdf/2305.06720.pdf

[8]https://github.com/LiuZhu-CV/BDLFusion

供稿:王迪

责任编辑:潘树孟